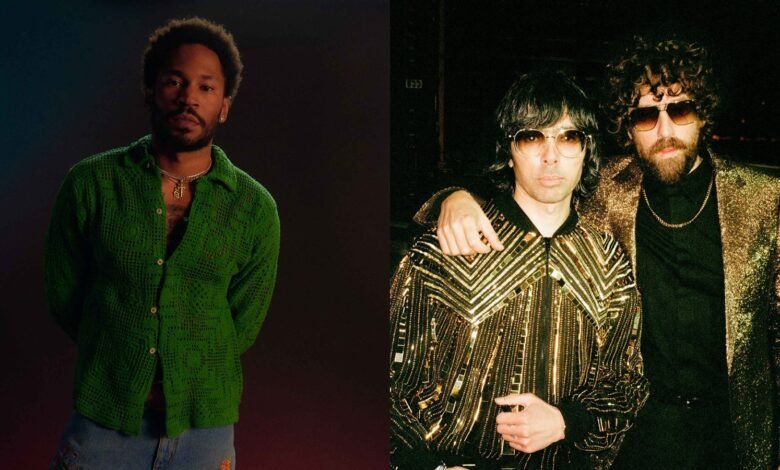

Kaytranada, Justice para embarcarse en la gira de América del Norte: ver las fechas

Kaytranada y Justicia están listos para llenar arenas. El jueves, los artistas de música electrónica anunciaron que irán a una gira de co-cabeza de 13 fechas a partir de octubre.

La racha de espectáculos comenzará en Vancouver el 16 de octubre antes de llegar a ciudades como Oakland, Denver, Chicago y Atlanta antes de cerrar la carrera en el Centro Kaseya de Miami el 16 de noviembre. El cartel turístico oficial para la carrera muestra una fecha anotada entre Oakland y San Diego que los fanáticos en línea creen que pueden ser un espectáculo especial en Los Ángeles.

Aquellos que buscan comprar boletos pueden inscribirse en la preventa en el sitio web de la gira con el acceso a la apertura del 22 de julio a las 10 am hora local. Todos los boletos saldrán a la venta el viernes 25 de julio a las 10 am hora local.

La carrera colaborativa no debería ser una gran sorpresa para los fanáticos como ambos compartió el proyecto de ley en el Festival de puntos III de Miami En octubre pasado, y más tarde Kaytranada remezcló el sencillo de Justice «Neverender,«Con Tame Impala.

La nueva carrera sigue el lanzamiento de los singles de Justice «Mannequin Love» con los Flints y «AfterImage» con Rimon. Su último álbum, Hiperdrama – Dirigido por «Hyperender» y «One Night/All Night» Wtih Tame Impala – cayó en abril de 2024. Mientras tanto, Kaytranada recientemente remezcló «The Mood» de Flo y «Oh Lala» de Justine Skye. Su último álbum, Eternofue lanzado en junio pasado.

Fechas de la gira de Kaytranada y Justice

16 de octubre – Vancouver, BC @ Rogers Arena

17 de octubre – Seattle, WA @ climated compromiso Arena

19 de octubre – Portland, o @ Moda Center

22 de octubre – Oakland, CA @ Oakland Arena

28 de octubre – San Diego, CA @ Viejas Arena

30 de octubre – Phoenix, AZ @ Phx Arena

1 de noviembre – Denver, Co @ Ball Arena

5 de noviembre – Chicago, IL @ United Center

No 8 – Brooking, NY @ Barclays Center

12 de noviembre – Atlanta, GA @ State Farm Arena

15 de noviembre – Tampa, FL @ Amalie Arena

16 de noviembre – Miami, FL @ Kasey Center