El creciente número de adolescentes recurre a la IA para interacciones sociales: estudio

No es una falla en la matriz: los miembros más jóvenes de la igeneración están recurriendo a los compañeros de chatbot para todo, desde consejos serios hasta entretenimiento simple.

En los últimos años, AI Technology ha avanzado hasta ahora para ver que los usuarios han ido directamente a los modelos de máquinas durante casi cualquier cosa, y las generaciones Z y Alpha están liderando la tendencia.

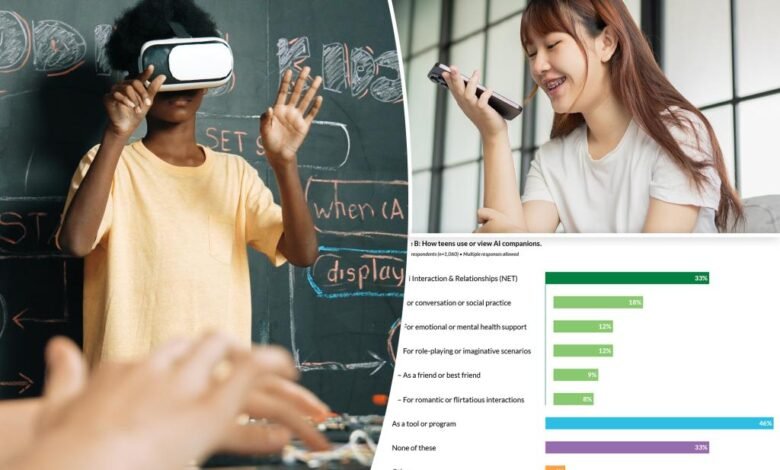

De hecho, un Mayo de mayo de 2025 Estudio Por sentido común, los medios analizaron la vida social de 1.060 adolescentes estadounidenses de 13 a 17 años y descubrieron que un sorprendente 52% de los adolescentes en todo el país usan chatbots al menos una vez al mes con fines sociales.

Los adolescentes que usaron chatbots de inteligencia artificial para ejercer habilidades sociales dijeron que practicaban iniciadores de conversaciones, expresando emociones, dando consejos, resolución de conflictos, interacciones románticas y auto-avocacia, y casi el 40% de estos usuarios aplicaron estas habilidades en conversaciones reales más adelante.

A pesar de algunos desarrollos de habilidades potencialmente beneficiosas, los autores del estudio ven el cultivo de comportamientos antisociales, la exposición al contenido inapropiado de la edad y un consejo potencialmente dañino dado a los adolescentes como razón suficiente para precaugar contra el uso de menores de edad.

«Nadie menor de 18 años debería usar compañeros de IA», escribieron los autores del estudio en la conclusión del artículo.

Las verdaderas campanas de alarma comenzaron a sonar cuando los datos descubrieron que el 33% de los usuarios prefieren recurrir a compañeros de IA sobre personas reales cuando se trata de conversaciones serias, y el 34% dijo que una conversación con un chatbot ha causado molestias, refiriéndose a la materia y la respuesta emocional.

«Hasta que los desarrolladores implementen una garantía de edad sólida más allá de la auto atestación, y las plataformas se rediseñan sistemáticamente para eliminar los riesgos relacionales de manipulación y dependencia emocional, el potencial de daños graves supera cualquier beneficio», advirtieron los autores de los estudios.

Aunque el uso de la IA ciertamente se está extendiendo entre las generaciones más jóvenes, Una encuesta reciente mostró que el 97% de Gen-Z ha utilizado la tecnología – El estudio de los medios de sentido común encontró que el 80% de los adolescentes dijeron que todavía pasan más tiempo con los amigos de IRL que los chatbots en línea. Descansa fácil, padres: los adolescentes de hoy todavía priorizan las conexiones humanas, a pesar de las creencias populares.

Sin embargo, se advierte personas de todas las generaciones contra la consultoría de IA para ciertos fines.

Como informó anteriormente la publicación, Los chatbots de IA y los modelos de idiomas grandes (LLM) pueden ser particularmente dañinos para aquellos que buscan terapia y tienden a poner en peligro a los que exhiben pensamientos suicidas.

«Las herramientas de IA, sin importar cuán sofisticadas, confíen en respuestas preprogramadas y grandes conjuntos de datos», dijo anteriormente Niloufar Esmaeilpour, un consejero clínico en Toronto, al Post.

«No entienden el ‘por qué’ detrás de los pensamientos o comportamientos de alguien».

Compartir información médica personal con chatbots de IA también puede tener inconvenientesComo la información que regurgitan no siempre es precisa, y quizás de manera más alarmante, no cumplen con HIPAA.

La carga de documentos de trabajo para obtener un resumen también puede llevarlo en agua caliente, ya que se pueden extraer y filtrarse los acuerdos de propiedad intelectual, los datos confidenciales y otros secretos de la compañía.